Аналитики из консалтинговой компании Gartner представили тренды в бизнесе, которые повлияют на принятие деловых и технологических решений в течение следующих трех лет. Одна из тенденций — управление доверием, рисками и безопасностью ИИ (AI TRiSM). Это новый подход, который включает фильтрацию и оценку подлинности контента, соблюдение AI-этики и законодательства, обеспечение конфиденциальности при обмене данными и пр.

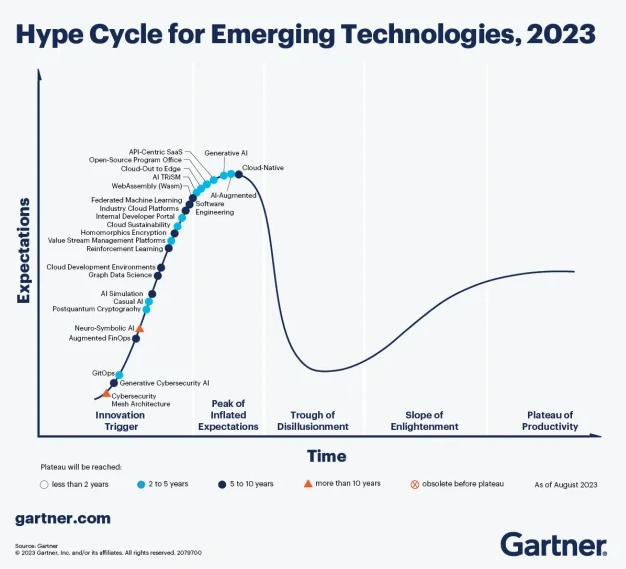

Мы продолжаем рассказывать о «Цикле хайпа», в который Gartner включили самые перспективные технологии ближайших лет и предположения об их развитии.

Что такое AI TRiSM

«Управление доверием, рисками и безопасностью ИИ (AI TRiSM) обеспечивает управление моделями ИИ, их достоверность, справедливость, надежность, устойчивость, эффективность и защиту данных. Сюда входят решения и методы для обеспечения интерпретируемости и объяснимости моделей, защиты данных ИИ, эксплуатации моделей и противодействия атакам противника».

Если переводить с технического языка на простой, то AI TRiSM должен защитить людей от ошибок, которые может допускать ИИ. Кстати, их пока что немало, а последствия могут быть самыми разными — от юридических казусов до гибели людей. Напомним несколько инцидентов, которые вполне могли бы войти в учебник по ИИ-безопасности:

- Пример 1. Адвокат из Нью-Йорка с 30-летней юридической практикой для подготовки документов по судебному делу использовал ChatGPT, который собрал ему несколько прецедентов, на которые юрист ссылался в своем заявлении. Но он не знал, что данные чат-бота могут быть недостоверными. Поиск этих дел по всем базам не дал результата — они просто никогда не существовали, а ChatGPT выдал их, чтобы поддержать позицию истца. Итог: у адвоката отобрали лицензию.

- Пример 2. Беспилотник ВВС США со встроенным ИИ в ходе испытаний принял решение уничтожить оператора дрона, а потом и вышку связи, через которую отдавали команды. Причина проста — все ради достижения своей главной цели: за выполнение задач ему начисляли баллы, а оператор периодически отменял нанесение ударов, то есть мешал повысить рейтинг. ИИ, который управлял дроном, счел человека угрозой. Испытания были имитационными, поэтому никто не пострадал.

- Пример 3. ИИ от Google в поисковике дает вредные советы: утверждает, что беременным полезно курить несколько сигарет в день, предлагает намазать клей на пиццу для лучшего прилипания сыра к ней, ссылается на статью, где рекомендует есть хотя бы один камень в день для улучшения настроения.

Вот для борьбы с такими случаями и разработан подход AI TRiSM, который помогает управлять моделью ИИ, обеспечивая ее объективность, надежность, прозрачность и защиту данных.

Каковы основные составляющие AI TRiSM

Существует 5 основных столпов, которые лежат в основе концепции управления доверием, рисками и безопасностью ИИ:

- Объяснимость. Это концепция обозначения всех возможных шагов для идентификации и мониторинга состояний и процессов ML-моделей. Проще говоря, это возможность обнаружить или определить, достигла ли модель поставленной цели. Благодаря этому организации могут отслеживать производительность своих моделей ИИ и предлагать улучшения, чтобы сделать процесс более эффективным и генерировать лучшие результаты с повышенной производительностью.

- ModelOps. Эта концепция нацелена на поддержание и управление жизненным циклом каждой модели ИИ, включая модели, основанные на аналитике, графах знаний, решениях и т. д.

- Обнаружение аномалий в данных. Этот компонент фокусируется на идентификации проблем и помогает специалистам по ИИ увидеть полную картину с данными для принятия эффективных решений.

- Сопротивление адверсионным атакам. Это атаки или угрозы ИИ, которые используют данные для нарушения алгоритмов машинного обучения и изменения функциональности моделей машинного обучения. Решение обнаруживает и устраняет эти угрозы, обеспечивая бесперебойную работу всего процесса.

- Защита данных. Основным источником «топлива» для моделей машинного обучения являются данные, поэтому чем лучше они защищены, тем лучше функциональность. AI TRiSM обеспечивает конфиденциальность и безопасность данных, чтобы соответствовать нормативным требованиям по защите данных, таким как GDPR.

Почему это в тренде

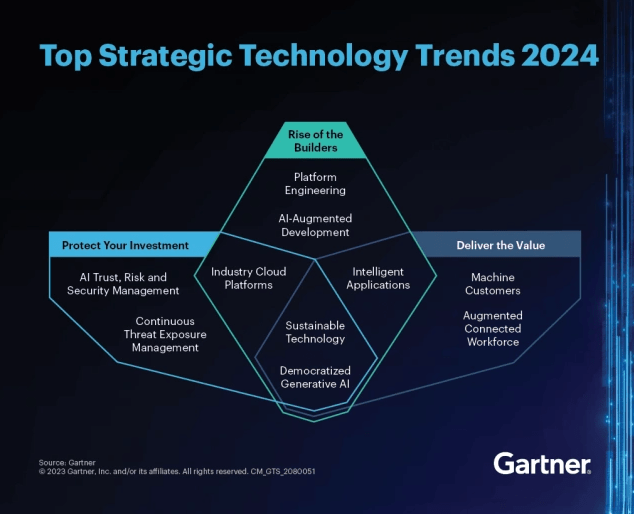

В Gartner представили карту, которая показывает, что каждая из тенденций связана с одной или несколькими ключевыми темами бизнеса. Они влияют на защита и сохранение инвестиций, принятие решений и обеспечение ценности для потребителей.

Кроме принципа AI TRiSM, в список трендов, вошли непрерывное управление рисками (CTEM), устойчивые технологии, разработка платформ, разработка с использованием ИИ, отраслевые облачные платформы, интеллектуальные приложения, демократизация генеративного ИИ, расширенная подключенная рабочая сила и клиенты-машины.

Что касается AI TRiSM, то аналитики Gartner выделили следующие преимущества:

- Люди, которые активно использует элементы управления AI TRiSM, запускают в работу больше проектов, связанных с этой технологией. В результате они получают большую выгоду от этого, и их модели работают точнее и лучше, чем у тех, кто этими инструментами не пользуется.

- Организации, которые используют программу TRiSM для управления своими моделями искусственного интеллекта, могут лучше понимать и предотвращать предвзятость в принимаемых решениях. Также они могут сделать свои программы с ИИ более объективными.

- Модель искусственного интеллекта должна быть понятной и легко проверяемой. Для этого нужно постоянно следить за ее работой и убеждаться, что все объяснения и интерпретации, которые мы давали ей изначально, остаются верными и не меняются со временем.

С чего начинается

В руководстве от Gartner представлена дорожная карта архитектуры AI TRiSM, состоящая из пяти пунктов.

Этап 1 — расширение сферы применения жизненного цикла модели (2020-2024 гг.)

Руководители организаций, участвующих в создании архитектуры AI TRiSM, будут сотрудничать с учеными, изучающими данные, разработчиками ИИ, руководителями служб безопасности и заинтересованными сторонами бизнеса, чтобы убедиться, что они понимают значение инструментов AI TRiSM и могут контекстуально применять их для разработки структуры безопасности.

Этап 2 — столкновение возможностей (2023-2025 гг.)

Речь идет о пересекающихся возможностях, присутствующих в AI TRiSM. Такие возможности, как ModelOps, объясняемость, мониторинг моделей, непрерывное тестирование моделей, функции конфиденциальности (включая технологии повышения конфиденциальности) и безопасность приложений ИИ, пересекаются друг с другом.

Этап 3 — управление моделями и конвергенция функций (2024-2026 гг.)

По мере распространения инструментов AI TRiSM поставщики ModelOps будут расширять свои возможности, чтобы охватить весь жизненный цикл AI-моделей.

Этап 4 — консолидация рынка (2025-2028 гг.)

По мере того как организации начинают внедрять инструменты AI TRiSM, Gartner ожидает консолидации рынка AI TRiSM вокруг двух его ключевых возможностей: ModelOps и функции конфиденциальности.

Этап 5 — AI-Augmented TRiSM (с 2029 года и далее)

Gartner прогнозирует внедрение AI-Augmented TRiSM, который организует регулирование с помощью искусственного интеллекта и человеческого надзора.

Прогнозы и будущее AI TRiSM

График Gartner в виде кривой показывает цикл развития каждой новой технологии в настоящее время. Он включает пять ключевых этапов, и AI TRiSM только начал переход от первой стадии (запуск) ко второй (пик завышенных ожиданий).

По прогнозам Gartner, к 2026 году организации, внедряющие этот принцип, увидят, что их модели ИИ на 50% улучшат показатели внедрения, достижения бизнес-целей и принятия пользователями. К 2027 году минимум одна корпорация получит запрет на использование ИИ от регулирующего органа за несоблюдение законов о защите данных. Также к 2027 году не менее двух компаний, предоставляющих функции управления рисками с помощью ИИ, будут приобретены поставщиками систем управления рисками предприятий.

Читать еще из рубрики «Цикл хайпа»:

Цикл технологического хайпа: читаем будущее инноваций

Распаковывая черный ящик: как работает Causal AI

Нейросимволический ИИ: что будет, если объединить два антагонистических подхода к ИИ