Специалисты JFrog обнаружили на Hugging Face вредоносные модели машинного обучения. Их установка может привести к выполнению кода со стороны атакующего для получения полного контроля над системой.

Специалистами JFrog было обнаружено более 100 вредоносных моделей ИИ на Hugging Face. Некоторые из них могут выполнять код на компьютере жертвы, предоставляя злоумышленникам постоянный бэкдор. Это происходит несмотря на меры безопасности платформы, включая сканирование вредоносных программ, pickle и secrets, а также тщательное изучение функциональности моделей для обнаружения таких поведенческих факторов, как небезопасная десериализация.

Hugging Face — технологическая фирма, занимающаяся искусственным интеллектом, обработкой естественного языка и машинным обучением, предоставляющая платформу, на которой сообщества могут сотрудничать и обмениваться моделями, наборами данных и готовыми приложениями.

Для обнаружения вредоносных моделей на Hugging Face группа специалистов из JFrog разработала и внедрила усовершенствованную систему сканирования. Она нацелена на проверку моделей PyTorch и Tensorflow Keras. В отчете говорится: «Важно подчеркнуть, что когда мы говорим о вредоносных моделях, мы конкретно обозначаем те, которые содержат реальную вредоносную полезную нагрузку. Этот подсчет исключает ложные срабатывания, обеспечивая подлинное представление распределения усилий по созданию вредоносных моделей для PyTorch и Tensorflow на Hugging Face».

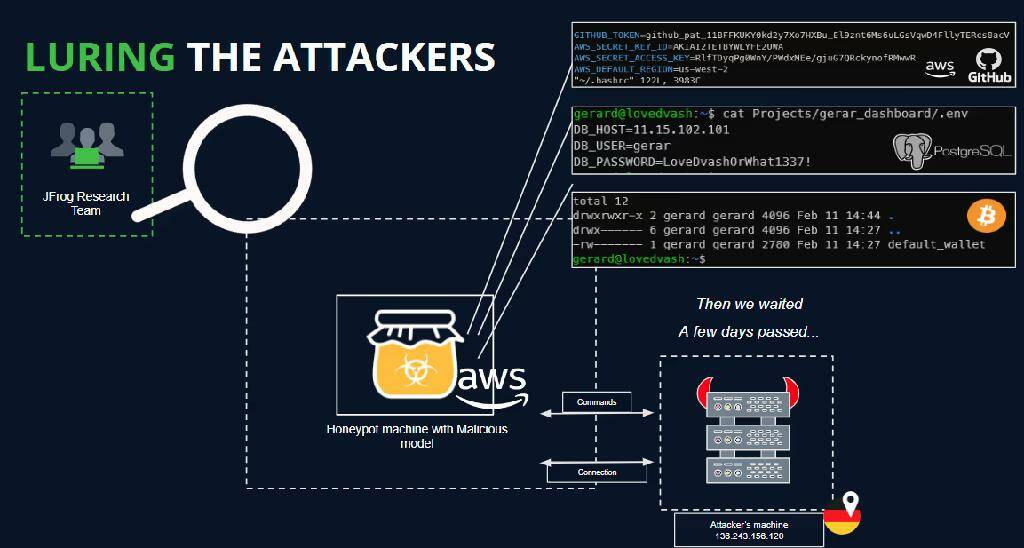

Настройка honeypot для заманивания злоумышленника в ловушку (JFrog)

В пример исследователи приводят то, что среда сканирования отметила модель PyTorch, загруженную пользователем с именем baller423. Вредоносная нагрузка модели использовала метод reduce модуля pickle в Python для выполнения произвольного кода при загрузке файла, избегая обнаружения путем внедрения кода в доверенный процесс сериализации. Сейчас модель удалена с HuggingFace.

Выполнение кода с помощью модели искусственного интеллекта (JFrog)

JFrog поясняет, что некоторые вредоносные загрузки могут быть частью исследований, направленных на обход мер безопасности Hugging Face. Однако опасные модели становятся общедоступными, а риск не следует недооценивать. Выводы JFrog подчеркивают эту проблему и требуют повышенной бдительности и разработку мер для защиты экосистемы от злоумышленников.