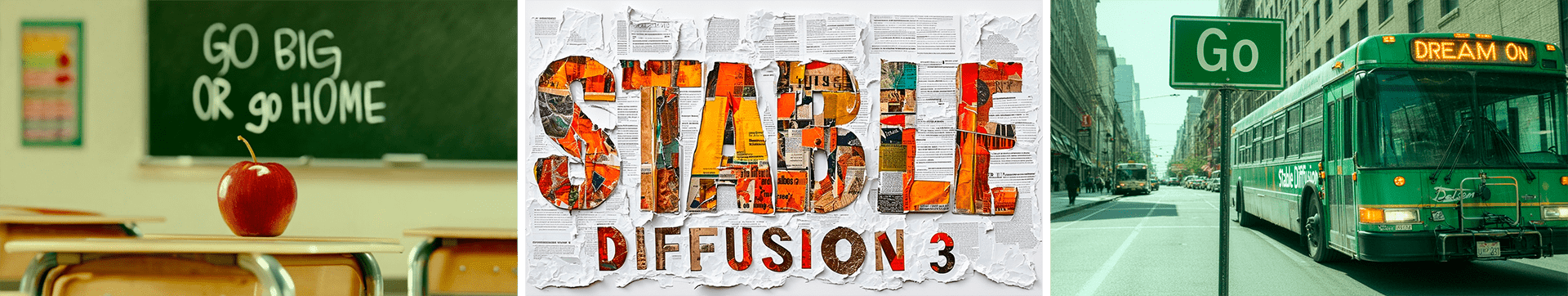

Анонсирована Stable Diffusion 3, которая обеспечивает быструю и точную генерацию изображений, похожую на DALL-E.

Stability AI представила новую версию Stable Diffusion. Набор моделей Stable Diffusion 3 варьируется от 800M до 8B параметров. Они основаны на открытом коде, их можно запускать и настраивать локально.

В новой версии используется архитектура diffusion transformer, представляющая способ создания изображений с помощью искусственного интеллекта, который работает с маленькими фрагментами вместо обычных блоков построения.

В Stable Diffusion 3 также применяется метод «согласования потоков», который обучает нейросеть плавному переходу от шума к структуре изображения. Это позволяет сосредоточиться на общем направлении или потоке, который определяет генерацию.

Компания стремится предлагать адаптируемые решения для раскрытия творческого потенциала пользователей. Примеры сгенерированных изображений Stable Diffusion 3 сравнимы с результатами других современных моделей синтеза, таких как DALL-E 3, Adobe Firefly, Midjourney и Google Imagen.

На данный момент модель доступна для определенного круга пользователей. Однако в Stability сообщили, что после тестирования, она будет доступна для бесплатного скачивания и локальной установки.