В этом году, наверное, не проходило ни дня без новостей, связанных с нейросетями. И хотя обычным пользователям пока еще доступны лишь относительно примитивные возможности нейросетей (какие именно – читайте здесь), специалисты по работе с машинным обучением и искусственным интеллектом продолжают строить для нас будущее с максимально персонализированными товарами, контентом, пищей и т.д. Ну а пока мы еще не в будущем, поговорим о том, чем удивляли нейросети в 2019.

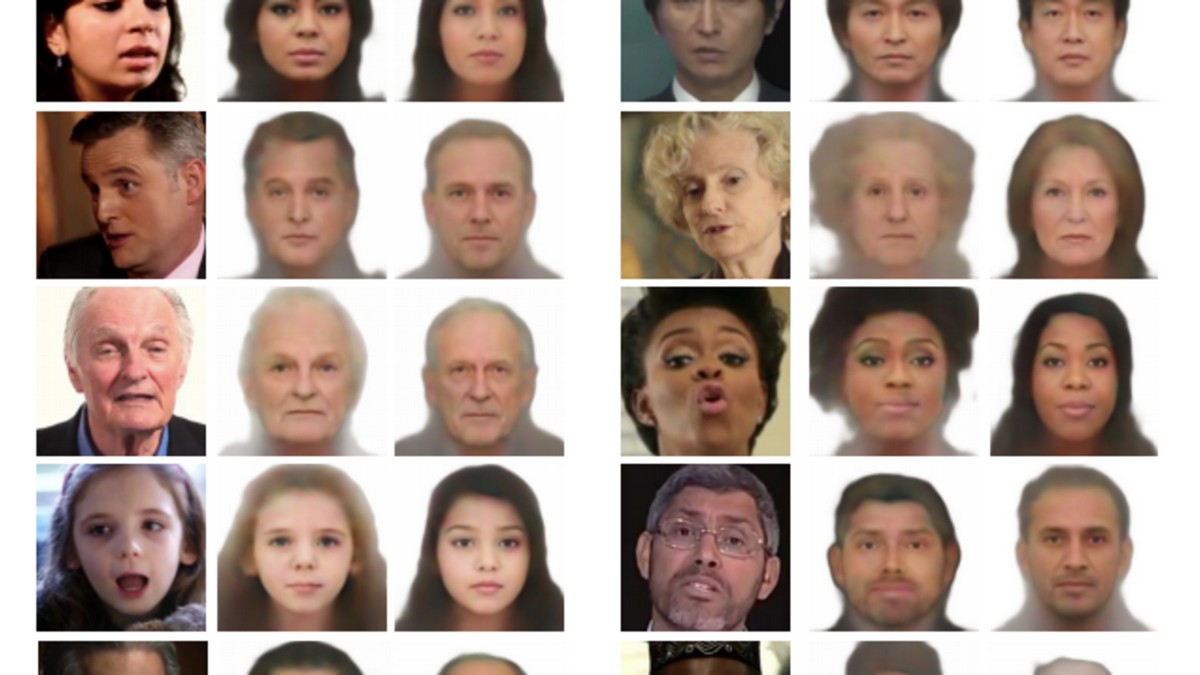

Определение внешности человека по голосу

Исследователи из Массачусетского технологического Института разработали нейросеть Speech2Face, воссоздающую портрет человека по звукам его речи. На момент выпуска первой версии Speech2Face определяла внешность с точность до 83% — по словам разработчиков, наибольшую сложность для нейросети представляет возраст человека, но с увеличением базы доступных дата-сетов, точность моделирования будет неуклонно расти. В перспективе этот проект может использоваться для автоматического создания аватаров в голосовых чатах.

Правдоподобная лицевая анимация

Сотрудники Samsung AI Center Moscow изобрели алгоритм способный всего по одному изображению человека создать вполне реалистичную анимацию его мимики. В идеале, нейросети требуется до 8 кадров, однако в большинстве случаев достаточно и одного.

https://www.youtube.com/watch?v=p1b5aiTrGzY

Таким образом удалось “оживить” портреты Сальвадора Дали, Альберта Эйнштейна и даже известную Мона Лизу.

Подмена движений людей на видео

В Facebook AI Research обучили нейросеть Vid2Game распознавать человека в видеоролике, подменять все кроме, собственно, этого человека, и изменять его движения.

Причем, нейросеть позволяет делать это с помощью клавиатуры и мышки, управляя реальным человеком, как в компьютерной игре.

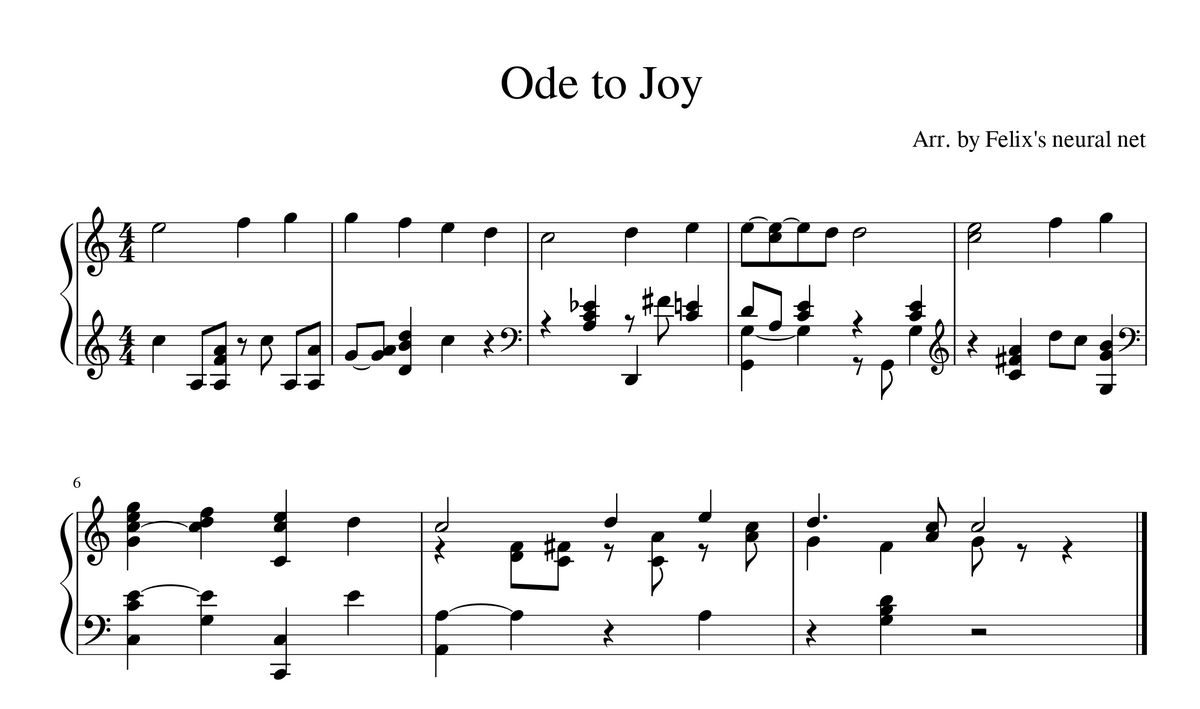

Нейросети осваивают новые музыкальные жанры

ИИ уже не первый год радует нас искусственно сгенерированными музыкальными произведениями, в этом году нейросети перешли с классической и поп-музыки к death metal и джазу. Правда, если в первом случае получается нечто более-менее адекватное, то с джазом все сложнее: иногда получается вполне удобоваримая джазовая музыка, а иногда – невнятная какофония из случайных звуков. Кстати, авторами канала DADABOTS являются разработчики, по совместительству еще и музыканты Джей Карр и Зак Зуковски.

Новые виды спорта

Тем, кому не нравится ни один из ныне существующих видов спорта, высокие технологии высокие технологии помогут придумать свой собственный спорт с адекватными правилами и прочими сопутствующими атрибутами. Например, компания AKQA создала нейросеть, которая на основе 7300 правил из 400 других видов спорта “изобрела” Speedgate – своеобразную помесь регби и обычного футбола.

Замена актеров в фильмах

Нет, речь не о полной замене живых актеров отрендеренными ботами с синтезированными голосами (хотя и такие проекты уже находятся в разработке). Сейчас речь идет о замене только лица, но и этого вполне достаточно, чтобы кардинально преобразить давно полюбившиеся картины. В этом году нейросети во всю раскрыли свой deepFake-потенциал, давайте взглянем на несколько классических фильмов, над которыми поработал ИИ.

Терминатор 2: Судный день. В этой сцене лицо Арнольда Шварценеггера заменили на Сильвестра Сталлоне:

Видимо, лицо Арнольда хорошо подходит для работы с нейросетями, поэтому в Сети гуляет еще один ролик, где на вечернем TV-шоу актер Билл Хейдер получил лицо и мимику “Железного Арни”:

https://www.youtube.com/watch?v=bPhUhypV27w

А здесь все еще забавнее. Тот же автор поставил на место Джека Николсона из фильма ужасов “Сияние” лицо Джима Керри. Вышло очень даже похоже, еще бы голоса так же заменить и получилась бы шикарная комедия:

https://www.youtube.com/watch?v=Dx59bskG8dc

Но самым любимым актером разработчиков нейросетей по праву считается Николас Кейдж, которого ставят на место сразу всех актеров в различных фильмах:

Мгновенный перевод с сохранением интонации и голоса

В мае Google объявила об успешном окончании работы над Translatotron – алгоритмом перевода устной речи с оригинальными интонацией, ударениями, тембром и другими мелочами, делающими голос каждого человека уникальным. Ключевая особенность Translatotron заключается в отсутствии необходимости конвертации аудио в текст, чем грешат все современные аудиопереводчики, включая Google Translate.

Система создает модель голоса, чтобы тут же передавать слова собеседника, экономя время и вычислительные ресурсы. У Translatotron огромнейший потенциал в образовательной и развлекательной областях, где существует океан полезного контента, недоступный пользователям, говорящим только на одном (читай, не английском) языке. Схожесть голосов пока далека от идеала, но Google продолжает совершенствовать эту нейросеть, “скармливая” ей все больше фраз, произнесенных различными людьми. С примерами можно ознакомиться в репозитории Google на GitHub.

Рисование сложных картинок по текстовому описанию

Исследовательская группа Microsoft Research представила генеративно-состязательную нейросеть ObjGAN (Object-driven Generative Adversarial Network), которая, в отличие от своих предшественников может создавать не просто схематичные картинки типа “палка-палка-огуречик получился человечек”, а вполне сложные объемные изображения похожие на настоящие фотографии. В основе ObjGAN лежит другая генеративно-состязательная нейросеть Microsoft – AttnGAN. Сравнить работу двух алгоритмов вы можете на следующем изображении:

Ранее сложность создания подобной нейросети заключалась в том, что искусственный интеллект не мог понять, как несколько объектов должны располагаться друг относительно друга в рамках одной композиции. Эта проблема была решена путем анализа открытого дата-сета COCO, содержащего разметку для 1.5 млн объектов.